Как перенести движения с любого видео на своего персонажа: Kling Motion Control

3 марта 2026 г.

Если вы хоть раз смотрели, как мультяшный герой танцует в TikTok точь-в-точь как живой человек - скорее всего, это сделано именно через Motion Control. Технология не новая, но раньше она была доступна только тем, у кого есть дорогое ПО и время разбираться. Kling сделал это простым: загрузил два файла, написал пару слов - и готово.

Разработана нейросеть компанией Kuaishou, это уже версия 2.6 Pro. Главное, что улучшили в этой версии - руки и мимику. Раньше пальцы часто "расплывались" или множились. Сейчас с этим заметно лучше.

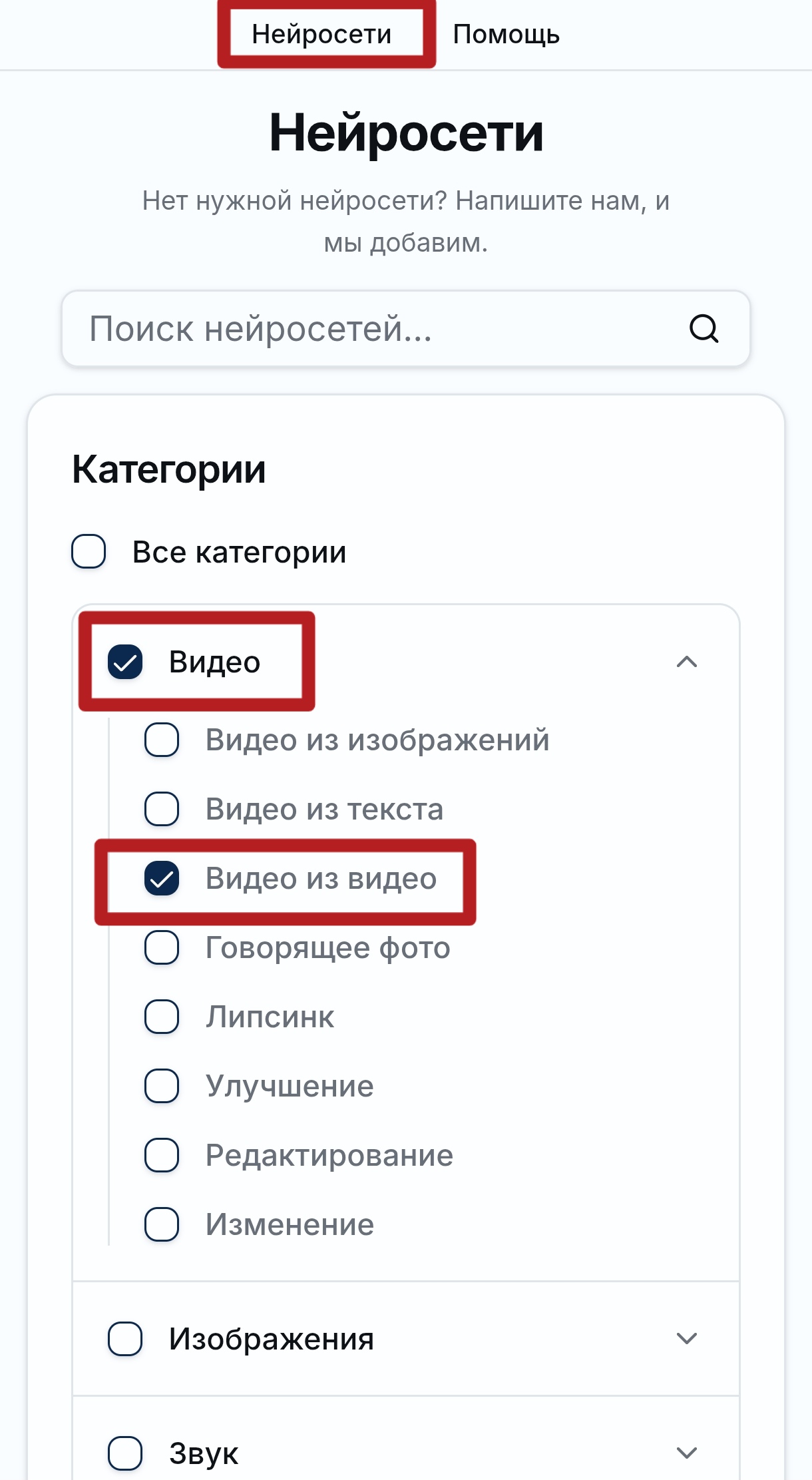

Где найти на Братуха.ру

Нейросети → раздел Видео → Видео из видео → Kling Motion Control

Что вообще происходит под капотом

Нейросеть не "рисует" движение с нуля. Она извлекает траекторию из вашего референсного видео - буквально разбирает, как двигается каждая часть тела в каждом кадре - и накладывает это на вашего персонажа. Поэтому результат получается точным, а не приблизительным.

Поддерживаются ролики от 3 до 30 секунд, выход - один непрерывный клип.

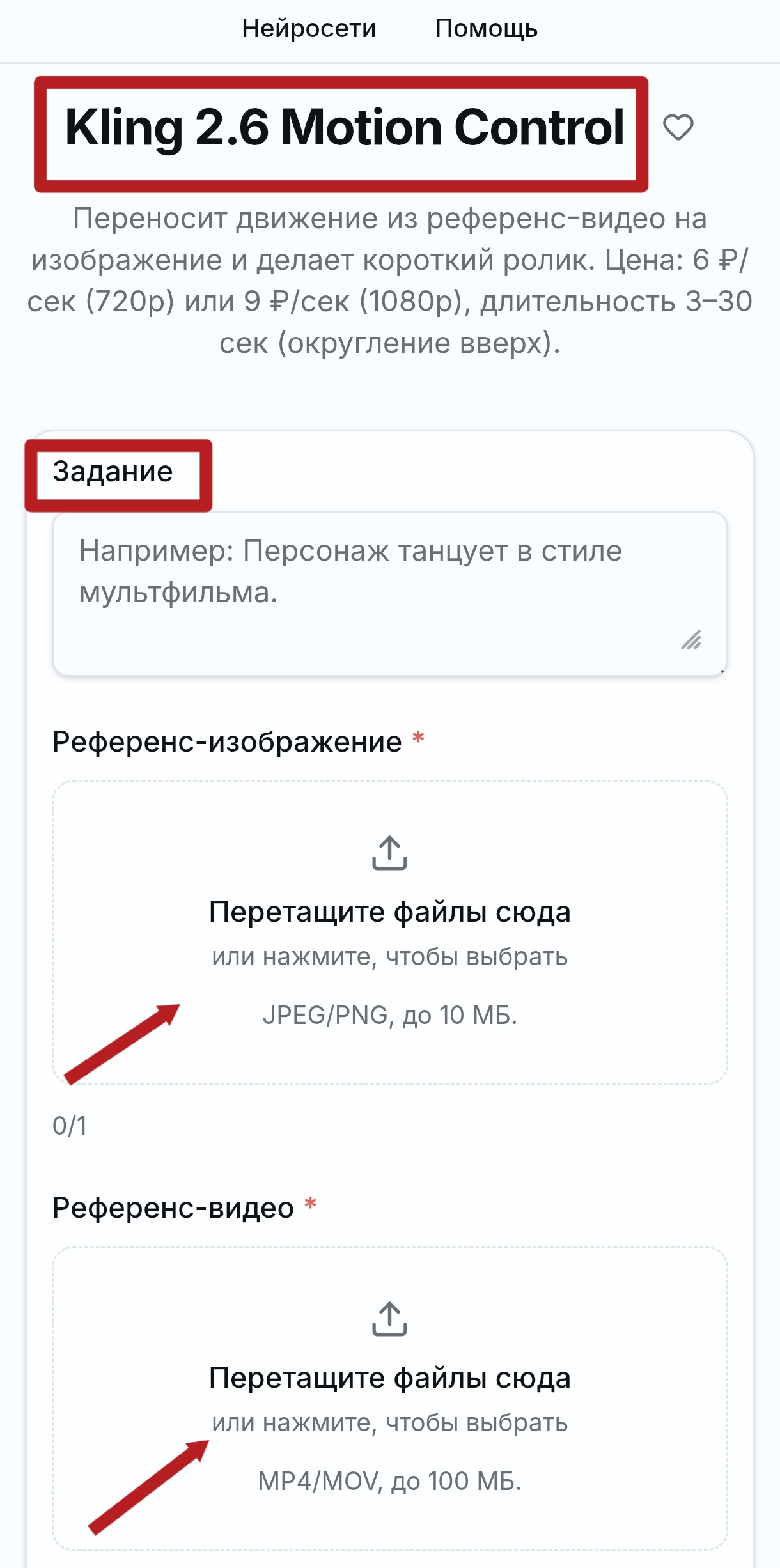

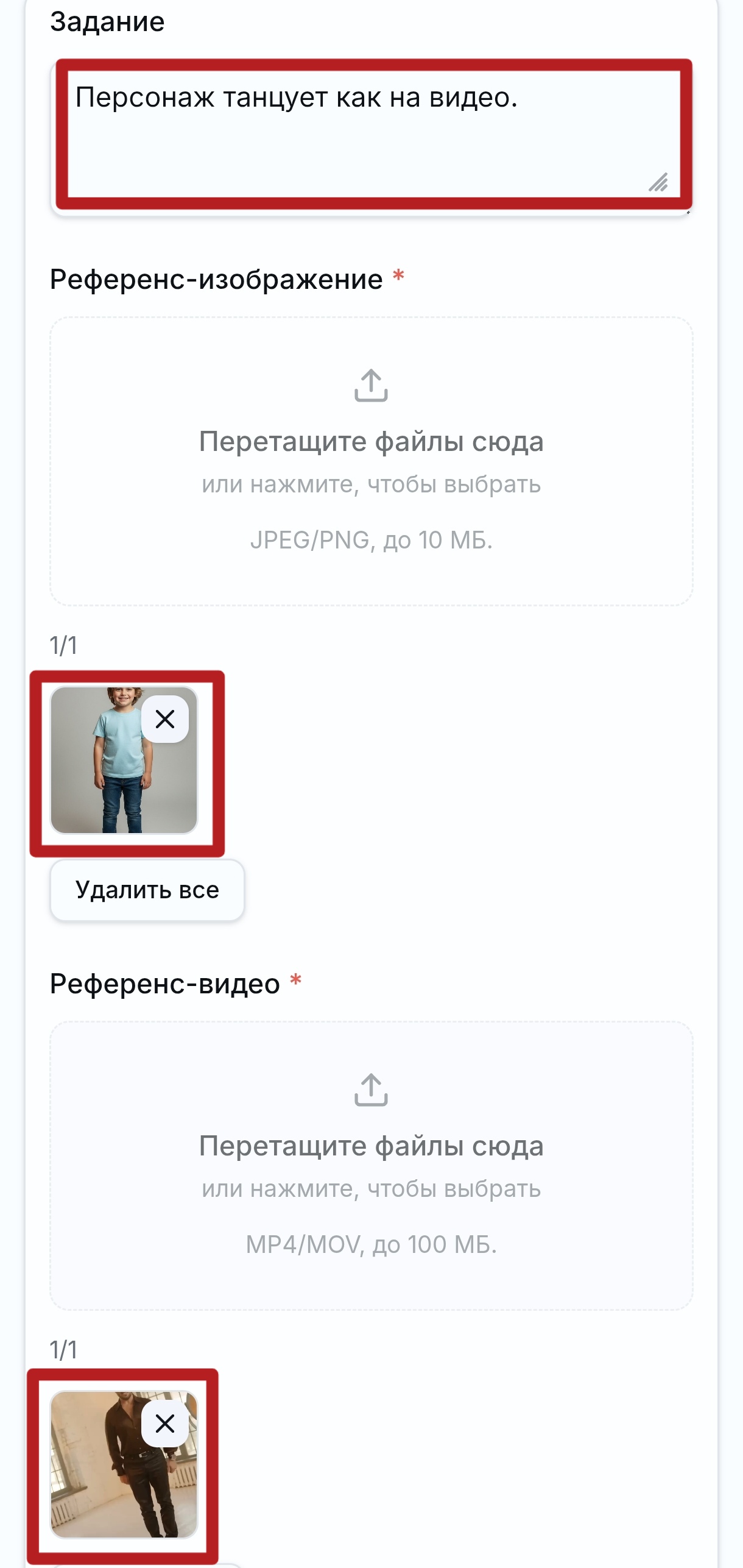

Что нужно подготовить

Два файла - это всё.

Референсное видео - то, откуда берём движения. Танец, боевая сцена, жест, ходьба - любое. Длина от 3 до 30 секунд. Чем чище съёмка и чем лучше видно фигуру - тем точнее результат.

Изображение персонажа - кто будет повторять эти движения. Реальный человек, нарисованный герой, 3D-модель, маскот бренда - подходит всё. Важно одно: персонаж должен быть виден в полный рост, и руки не должны быть спрятаны.

Про руки отдельно: если на картинке персонаж стоит с руками в карманах, а в видео нужно активно жестикулировать - нейросеть начнёт додумывать, и вот тут могут появиться лишние пальцы или странные углы. Лучше сразу выбрать изображение с открытыми руками.

Загрузить файлы можно перетащив их в поле или, нажав на соответствующую область, выбрать из галереи.

Промпт - зачем он здесь

В этом режиме текстовый промпт не управляет движением - это делает видео. Зато через промпт можно изменить фон и атмосферу сцены, не трогая саму анимацию.

Пишите коротко. Примеры: «Персонаж танцует», «Персонаж двигается как на видео».

Настройки перед запуском

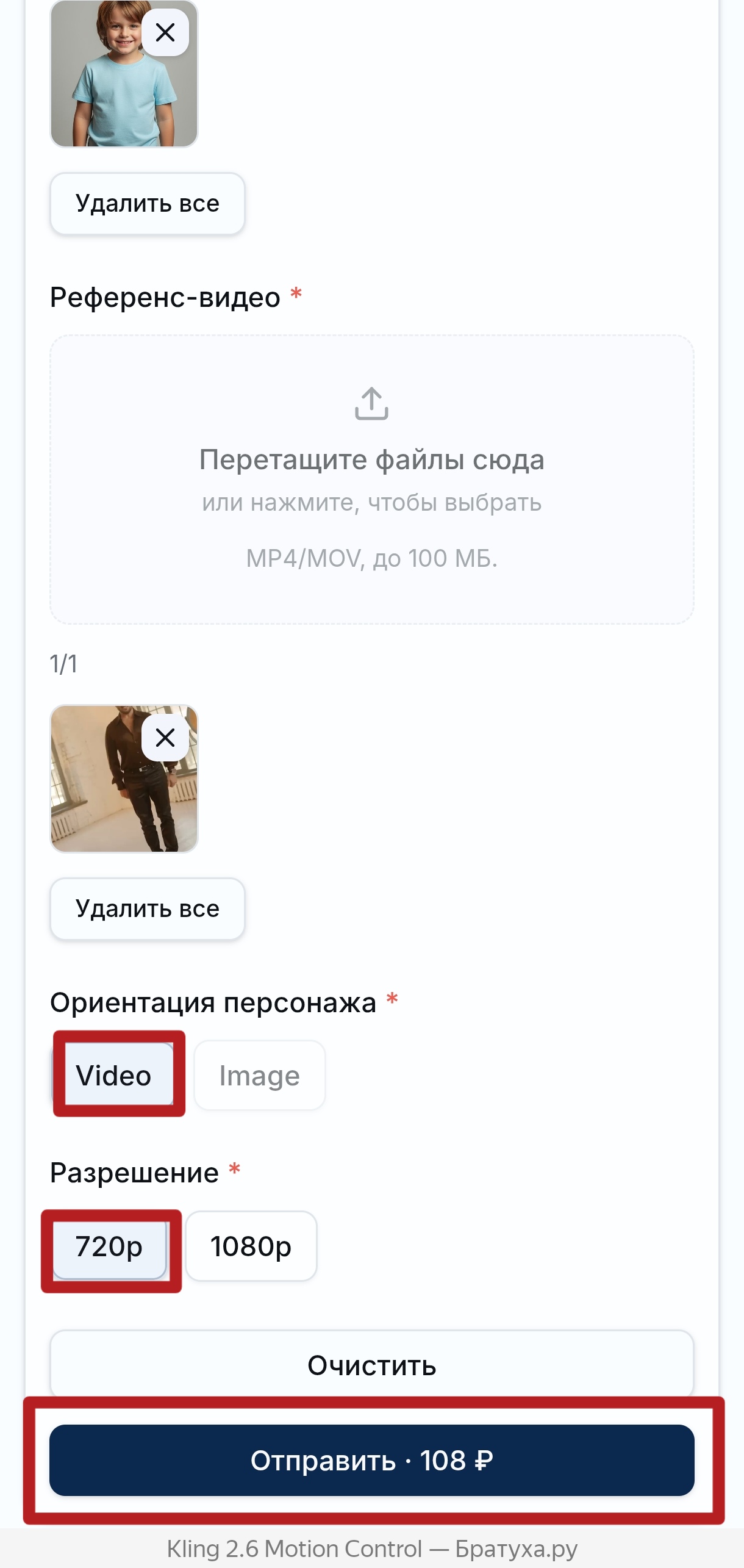

Ориентация персонажа - здесь выбираете логику работы с камерой:

- Видео - персонаж будет расположен так же, как в референсном видео, камера повторит оригинальный ракурс

- Изображение - сохранится исходный ракурс вашего персонажа, но движение при этом всё равно применится

Если не знаете, что выбрать - начните с «Видео», это работает в большинстве случаев.

Разрешение - выберите нужное качество.

Длину ролика нейросеть определяет сама по длине референса.

Стоимость генерации отображается прямо на кнопке «Отправить».

Отправляем и ждём

Нажмите «Отправить». Генерация занимает несколько минут - зависит от длины видео и загрузки серверов.

Если открываете на телефоне и результат не появился - потяните экран вниз, чтобы обновить страницу.

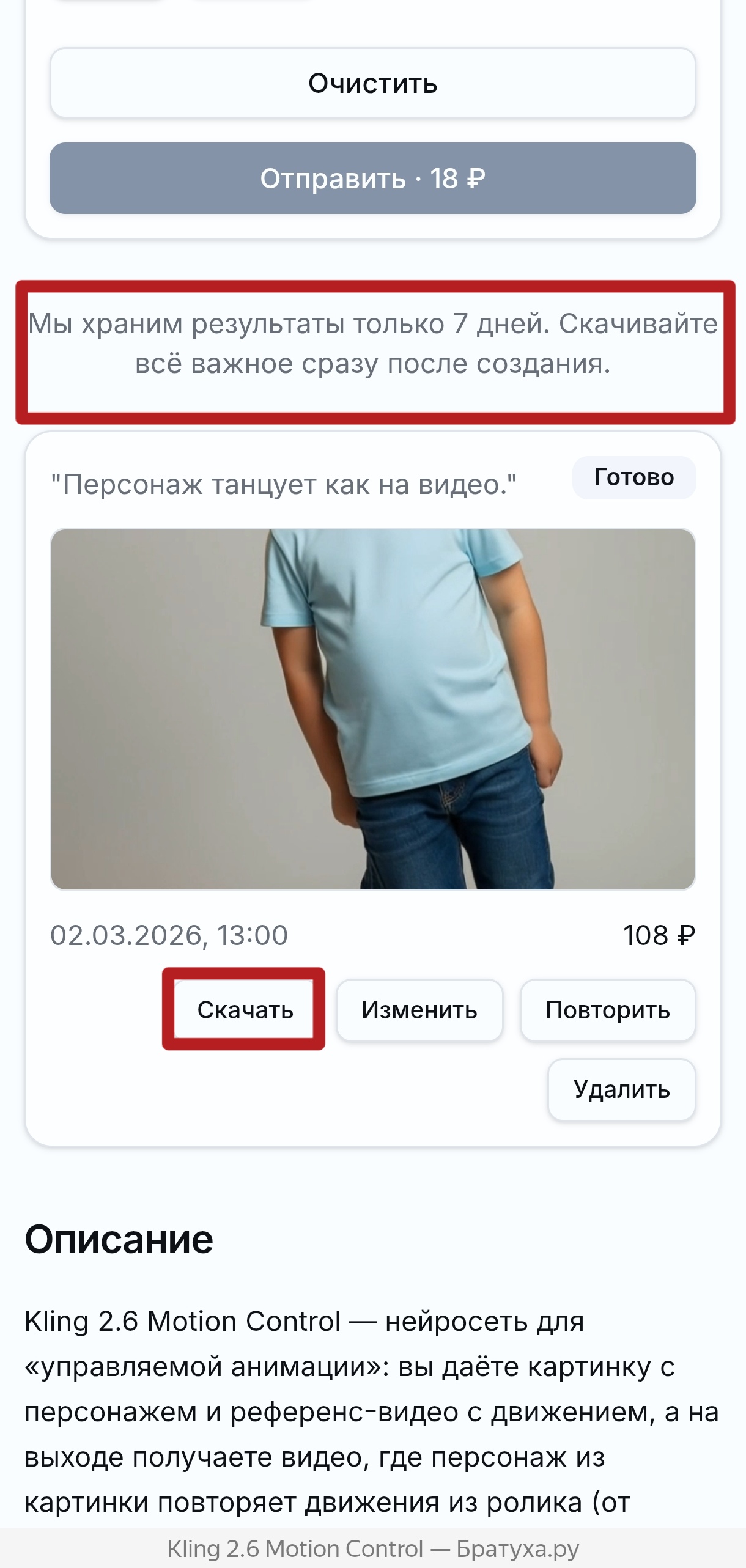

Когда видео готово, можно просмотреть прямо на сайте, скачать или запустить повторную генерацию - иногда второй вариант выходит лучше первого.

После готовности можно:

- Просмотреть результат

- Скачать видео

- Отправить повторный запрос для альтернативной версии

Примеры видео, созданных с помощью Kling Motion Control

Где это реально использовать

- Соцсети. Наложить вирусный танец на своего персонажа или OC - без монтажёра и аниматора. Один референс, любой герой.

- Маркетинг. Перенести жесты живого человека на маскота бренда. Записал один перформанс - получил несколько вариантов с разными персонажами.

- Корпоративный контент. Обучающие видео с виртуальными сотрудниками: один видео-инструктор, разные аватары для разных регионов или аудиторий.

- Сложные движения. Боевые искусства, акробатика, синхронные танцы - нейросеть справляется без распада персонажа даже на быстрых и сложных последовательностях.

- Контроль камеры. Если нейросеть слишком агрессивно двигает камеру - пропишите в промпте: «tripod, no zoom, no shake». Камера зафиксируется.

Частые вопросы

Можно ли использовать видео из интернета как референс?

Технически да, нейросеть примет любой подходящий по формату файл. Следите за тем, чтобы в кадре было хорошо видно фигуру - тёмные или размытые видео дают худший результат.

Сохраняется ли звук из референсного видео?

Да, есть сохранение оригинального звука.

Что делать, если движения получились неточными?

Попробуйте более чистый референс с хорошим освещением и чётко видимой фигурой. Иногда в Моушен контроле помогает повторная генерация - результаты немного отличаются от раза к разу.

Нейросеть подходит только для людей?

Нет. Можно анимировать и объекты - мебель, транспорт, любые физические элементы. Но лучше всего она работает с персонажами человекоподобной формы.

Сколько стоит генерация?

Стоимость зависит от длины видео и выбранного разрешения. Точная цифра в рублях отображается на кнопке «Отправить» до запуска.